最简单的方法就是直接修改 ~/.bashrc 或者 ~/.bash_aliases文件,添加如下代码: alias python=python3 然后运行 source ~/.bash_aliases #或者 #source…

Python 网络爬虫:Urllib库的基本使用, requests不建议使用?

Python 是一种面向对象、解释型计算机程序设计语言,由Guido van Rossum于1989年底发明,第一个公开发行版发行于1991年,Python 源代码同样遵循 GPL(GNU General Public License)协议。Python语法简洁而清晰,具有丰富和强大的类库。

Python3不像2x中酷虎的和服务器模块结构散乱,Python3中把这些打包成为了2个包,就是http与urllib,详解如下:

http会处理所有客户端–服务器http请求的具体细节,其中:

(1)client会处理客户端的部分

(2)server会协助你编写Python web服务器程序

(3)cookies和cookiejar会处理cookie,cookie可以在请求中存储数据

urllib是基于http的高层库,它有以下三个主要功能:

(1)request处理客户端的请求

(2)response处理服务端的响应

(3)parse会解析url

urllib and urllib2 区别

- urllib和urllib2模块都做与请求URL相关的操作,但他们提供不同的功能。

- urllib2.urlopen accepts an instance of the Request class or a url, (whereas urllib.urlopen only accepts a url 中文意思就是:urllib2.urlopen可以接受一个Request对象或者url,(在接受Request对象时候,并以此可以来设置一个URL的headers),urllib.urlopen只接收一个url

- urllib 有urlencode,urllib2没有,这也是为什么总是urllib,urllib2常会一起使用的原因

除了使用官方标准库的urllib,我们可以使用更好用的第三方模块,如requests

Requests 完全满足如今网络的需求,其功能有以下:

国际化域名和 URLs

Keep-Alive & 连接池

持久的 Cookie 会话

类浏览器式的 SSL 加密认证

基本/摘要式的身份认证

优雅的键/值 Cookies

自动解压

Unicode 编码的响应体

多段文件上传

连接超时

支持 .netrc

适用于 Python 2.6—3.4

线程安全

1.分分钟扒一个网页下来

怎样扒网页呢?其实就是根据URL来获取它的网页信息,虽然我们在浏览器中看到的是一幅幅优美的画面,但是其实是由浏览器解释才呈现出来的,实质它是一段HTML代码,加 JS、CSS,如果把网页比作一个人,那么HTML便是他的骨架,JS便是他的肌肉,CSS便是它的衣服。所以最重要的部分是存在于HTML中的,下面我们就写个例子来扒一个网页下来。

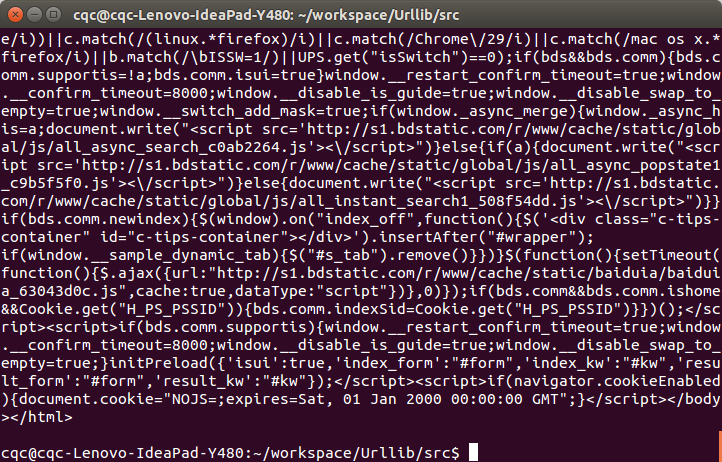

看,这个网页的源码已经被我们扒下来了,是不是很酸爽?

2.分析扒网页的方法

那么我们来分析这两行代码,第一行

response = urllib2.urlopen("http://www.baidu.com")

首先我们调用的是urllib2库里面的urlopen方法,传入一个URL,这个网址是百度首页,协议是HTTP协议,当然你也可以把HTTP换做FTP,FILE,HTTPS 等等,只是代表了一种访问控制协议,urlopen一般接受三个参数,它的参数如下:

import urllib

import urllib2

values = {"username":"XXXX","password":"XXXX"}

data = urllib.urlencode(values)

url = "https://passport.csdn.net/account/login?from=http://my.csdn.net/my/mycsdn"

request = urllib2.Request(url,data)

response = urllib2.urlopen(request)

print(response.read())

我们引入了urllib库,现在我们模拟登陆CSDN,当然上述代码可能登陆不进去,因为CSDN还有个流水号的字段,没有设置全,比较复杂在这里就不写上去了,在此只是说明登录的原理。一般的登录网站一般是这种写法。

我们需要定义一个字典,名字为values,参数我设置了username和password,下面利用urllib的urlencode方法将字典编码,命名为data,构建request时传入两个参数,url和data,运行程序,返回的便是POST后呈现的页面内容。

注意上面字典的定义方式还有一种,下面的写法是等价的

import urllib

import urllib2

values = {}

values['username'] = "XXXX"

values['password'] = "XXXX"

data = urllib.urlencode(values)

url = "http://passport.csdn.net/account/login?from=http://my.csdn.net/my/mycsdn"

request = urllib2.Request(url,data)

response = urllib2.urlopen(request)

print(response.read())

以上方法便实现了POST方式的传送

GET方式:

至于GET方式我们可以直接把参数写到网址上面,直接构建一个带参数的URL出来即可。

import urllib

import urllib2

values={}

values['username'] = "XXXX"

values['password']="XXXX"

data = urllib.urlencode(values)

url = "http://passport.csdn.net/account/login"

geturl = url + "?"+data

request = urllib2.Request(geturl)

response = urllib2.urlopen(request)

print(response.read())

你可以print geturl,打印输出一下url,发现其实就是原来的url加?然后加编码后的参数

和我们平常GET访问方式一模一样,这样就实现了数据的GET方式传送。

本节讲解了一些基本使用,可以抓取到一些基本的网页信息,小伙伴们加油!

requests不建议使用?

IV. requests不是python自带的库,需要另外安装 easy_install or pip install

V. requests缺陷:直接使用不能异步调用,速度慢(from others)。官方的urllib可以替代它。

如果你使用python以外的语言,你可能会认为urllib和urllib2很容易使用,代码不多,而且功能非常强大,这就是我以前的想法。但是,请求包是如此令人难以置信的有用和简短,每个人都应该使用它。

首先,它支持一个完全安全的API,并且像以下一样简单:

import requests

...

resp = requests.get('http://www.mywebsite.com/user')

resp = requests.post('http://www.mywebsite.com/user')

resp = requests.put('http://www.mywebsite.com/user/put')

resp = requests.delete('http://www.mywebsite.com/user/delete')

无论GET / POST是否都不需要再编码参数,它只需要一个字典作为参数,并且很好。

userdata = {"firstname": "John", "lastname": "Doe", "password": "jdoe123"}

resp = requests.post('http://www.mywebsite.com/user', data=userdata)

加上它甚至有一个内置的json解码器(再次,我知道json.loads()不是很多写,但这肯定是方便的):

resp.json()

或者如果您的回复数据只是文本,请使用:

resp.text

更多内容,移步到:Python 网络爬虫:利用requests模拟登录实例讲解, 手把手教你利用session/cookie模拟登录

本文:Python 网络爬虫:Urllib库的基本使用, requests不建议使用?

![]()